2021年夏のインターンシップに参加したお茶の水女子大学の松本茉倫です.インターンシップでは「局所差分プライバシを適用したFederated Learningの安全性評価」について研究しました.

本研究に関する論文は,第14回データ工学と情報マネジメントに関するフォーラム (DEIM2022) にて、3月1日に同タイトル(プライバシを保護したFederated Learningの安全性評価)発表予定です.

研究背景

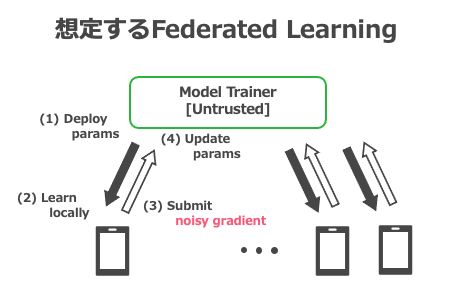

クライアントが持つデータを集約せずに分散した状態で機械学習を行う方法として,2016年に提唱されたFederated Learningがあります.

Federated Learningは,サーバから配布されたグローバルモデルを使ってクライアントが自身の持つデータの勾配を計算し,サーバが勾配を集約すること(平均化など)で学習モデルを更新する方法です.

一見するとプライバシ保護されているように思えますが,クライアントが生成した勾配から元データが復元される恐れがあるとされています.

プライバシ保護をした状態でFederated Learningを行う方法の一つとして,勾配の局所差分プライバシ(以下 LDP: Local Differential Privacy)を保証したランダム化が挙げられます.

LDPを適用することによって,どんな2つの勾配でもプライバシパラメータϵで表される程度に識別を困難にします.

ϵは小さいほど保証されるプライバシ強度は高くなりますが,ϵをどのように解釈・決定すれば良いかの判断材料が不足しています.

つまり,ϵ=10よりもϵ=1の方がプライバシ保護は強いことは分かっていても,ϵ=10を設定すると「〇〇攻撃に対してXX程度耐えられる」といった基準は十分に分かっていません.

提案

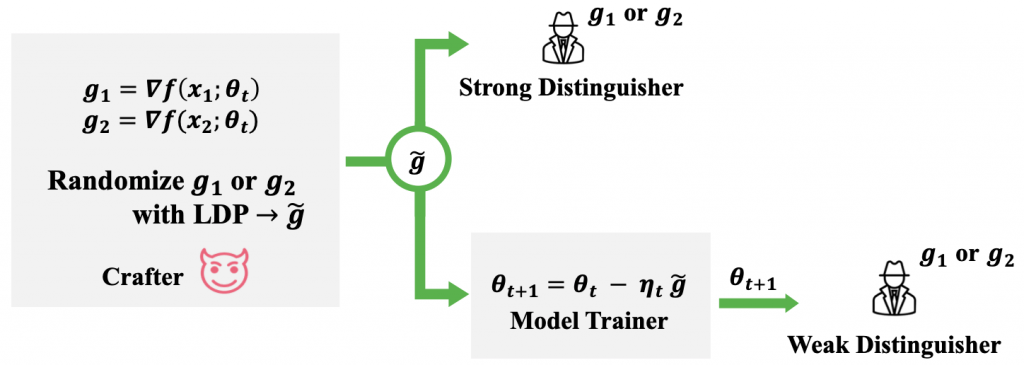

本研究では,Federated Learningで送信する勾配の判別可能性を以下のように検査することで経験的なプライバシ強度を得ることを考えました.

- Crafter が2つの勾配g1,g2のうち1つをランダム化し,

g̃とする. - Model Trainer は

g̃で学習したモデルθt+1を出力. - Distinguisher は

g̃またはθt+1から,ランダム化された勾配がg1,g2のどちらかを当てる.

1~3を十分な回数繰り返し,g1,g2を判別可能な確率を求めます.

このとき,2つの勾配を判別可能な確率が高くなるほどにランダム化手法のプライバシ強度が十分でなく,逆に判別可能な確率が低くなるほどプライバシ強度が高いことを示すことができます.

画像や勾配を加工するMaliciousなCrafterを想定した場合や,CrafterとModel Trainerが共謀した場合などアクセスレベルの異なる4つの設定で検査を行います.

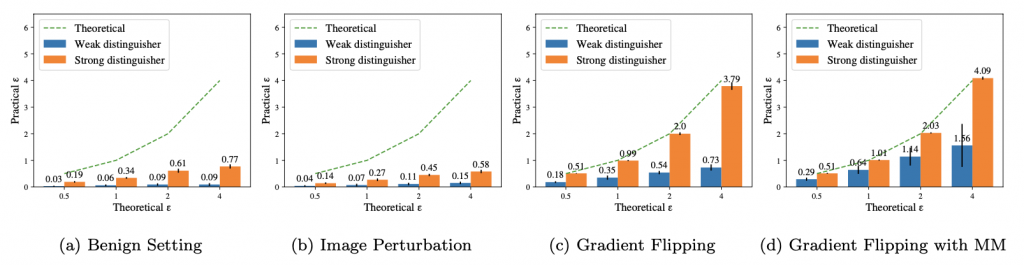

下図の実験結果は,横軸がTheoretical ϵ(ランダム化の際に設定した理論値)で,縦軸がPractical ϵ(経験的なプライバシ強度)です.(a), (b), (c), (d)の順に各エンティティがMaliciousになる設定です.

(a)はどのエンティティもMaliciousでない場合の結果ですが,TheoreticalとPracticalのギャップが大きいことが分かります.

反対に,(d)のCrafterとModel Trainerが共謀した場合はPracticalがTheoreticalとほぼ一致しています.つまり,経験的なプライバシ強度が理論値に達するためには,現実的とは言い難い設定を想定した場合であることが分かりました.

このような結果から,本研究ではCrafter・Model Trainer・Distinguisherに制限を加えることで,ϵ=4を設定しても実際にはϵ=1相当のプライバシ保護を達成できる,といったϵの緩和の可能性の探究を今後の課題としています.

まとめ

本記事では,LINEのインターンシップで取り組んだ,プライバシ保護したFederated Learningの安全性評価に関する研究について紹介しました.

感想

LINEのインターンシップに参加して印象的だったのは,開発環境の素晴らしさです.環境構築が面倒なJupyter Notebook・PyTorchなど機械学習ライブラリがすぐに使えるようになっているため研究に集中できました.

また,大学では全く違うテーマで研究していたので,インターンシップに参加が決まるまでは差分プライバシについては聞いたことある程度でした.

差分プライバシの分野で初心者の私でも,メンターの方からのサポートで研究成果をまとめることができました.

自分の研究テーマの幅を広める意味でも,とても有意義なインターンシップだったと思います.

今差分プライバシの分野以外で活躍している方にもぜひこのインターンシップに挑戦していただきたいです.