大家好,我是 Wei-I,現職 LINE 的 TECH FRESH Intern ,以下分享今年在 Dev Day 的由 Masashi Sugiyama 帶來的 The past and future of machine learning research。講者 Masashi 是東京大學專研機器學習的教授,在這次演講中主要提及了幾個關於 Robust Machine Learning 的研究成果,以及他對未來機器學習研究的看法。

Robust Machine Learning

首先 Robust Machine Learning 想解決的問題,概略來說就是讓機器學習的模型,在各種『不盡如人意』的條件下,依然能有足夠好的準確度。為什麼會好奇模型在不利的條件下的表現呢?在現實環境的運用中,因為種種因素,這些模型不得不面對這些狀況,其中包括 Noise (雜訊)、Insufficient supervision(不完全監督)、Bias(偏差)等。

Noise(雜訊)

實際環境中,收集的資料幾乎都不是完美的,錯誤的來源可能非常多,可能是感應器沒辦法做到 100% 精準 (sensor error),可能是人工貼標籤時不小心標錯 (human error),因此機器學習模型必須要有能力抵抗這些錯誤。標準的做法包括偵測錯誤樣本並移除後再訓練、使用 robust loss 或是更強的 regularization 等,這些做法能抵抗較弱的雜訊,但在資料非常髒時都表現的不夠好,因此講者探討了三類做法:

- Noise Transition Correction:如果我們能知道標籤是如何被標錯的,就能作出對應的修正。這一類做法利用 Noise Transition Matrix 來 model 各個標籤被錯標成其他標籤的機率,有了這個資訊就能『除噪 (eliminate noise)』或是讓模型『模擬噪音 (simulate noise)』。但 Noise Transition Matrix 一般來說是也是未知的資訊,因此講者提出一系列從充滿雜訊的資料中學習 Noise Transition Matrix 的方法來解決這個問題。

- Co-teaching:這是一個使用深度學習的方法,此方法利用兩個架構完全相同的神經網路 A 與 B,互相從不同的資料中學習,並找出乾淨較無雜訊的資料,互相『教』對方。因為這個互相學習並教對方的過程,稱此方法為『Co-teaching』。雖然這類方法尚無理論上的保證,但是實際的實驗顯示相當有效,讓模型互相教對方的概念也很有趣。

- Flooding:這也是一個使用深度學習的方法,也是筆者認為相當新奇的做法。操作過深度學習的讀者常有的經驗是神經網路模型有非常強擬合資料的能力,但也非常容易過擬合。那是不是只要讓模型『不那麼擬合』就能改善這個問題呢?講者提出 Flooding 的做法,讓訓練資料上的錯誤率在足夠低之後便不再繼續下降,但是繼續使用梯度下降法來訓練模型,這樣便能夠讓測試資料的錯誤率進一步降低,也就是能再繼續改進模型的泛化性能。

Insufficient supervision(不完全監督)

大部分的模型都需要特徵 (feature)、標籤 (label) 才能開始訓練,稱為監督式學習 (supervised learning);有特徵無標籤的則稱為無監督式學習 (unsupervised learning)。但許多數據屬於有特徵以及有一些不完全的標籤,在這種資訊不是非常足夠的情境下學習的問題稱為或弱監督學習 (weakly supervised learning),例如

- Complementary classification:這個問題中,模型能拿到『反面的標籤』,例如說一張蘋果的圖片,可能是貼上『這不是橘子』的標籤。這種類型的標籤取得成本較低,因此也能應用於實際問題中,講者提出了使用 Unbiased risk estimation 等做法來解決此問題。

- Partial-label classification:這算是前一個問題的推廣,模型能拿到一群可能是對的答案,同樣以蘋果的圖片舉例,拿到的標籤可能是『這是橘子、蘋果、香蕉其中一種』。對於此問題,講者提出兩種做法,分別為逐步的辨識出正確的標籤、以及直接 model 標籤生成的過程。

- 其他:弱監督學習是許多不同種問題的集合,基於標籤收集不易或成本過高等原因,資料通常不帶有完全正確的標籤,而是以其他類型的資訊表達出來。有興趣的讀者可以至 Masashi 的個人網站尋找相關的文章。

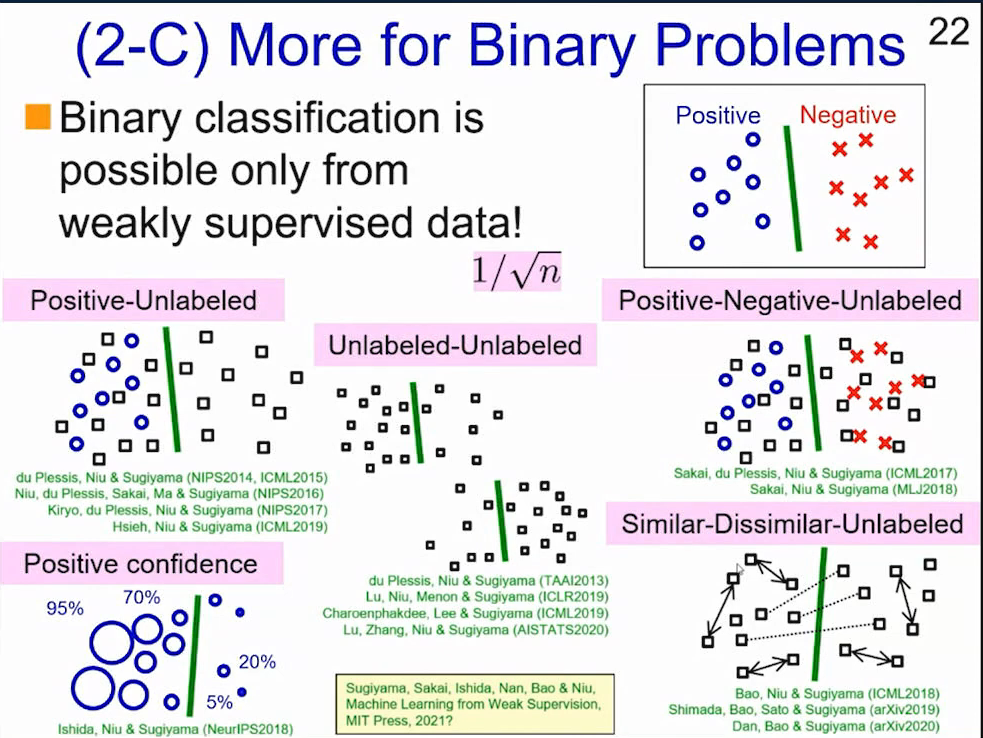

直接取自講者投影片,弱監督學習還有非常多種『資訊不完全』的形式的分類問題。

Bias in Training Data(資料的偏差)

一般來說,模型應用於的資料分佈若與訓練時的資料分佈相近,會有較好的表現。但實際應用時通常不是如此,在一些應用場景,分佈可能非常迅速地變化(例如說用於推薦系統時);再來是選擇用於訓練的資料很有可能也帶有一定的偏誤(sample selection bias),導致與應用時的資料分佈有所差異。解決這種狀況下的學習問題包括遷移學習 (Transfer Learning) 等,講者也提出了一系列非監督遷移學習 (Unsupervised transfer learning) 的方法來讓訓練與測試的資料分佈更相近的做法。

Future ML Research

現有機器學習的技術成熟到能用於許多簡易的問題,例如圖像辨識、語音辨識等,但是許多問題在學界仍屬於開發中的狀態,例如 one-shot/few-shot learning (如何從非常少量的資料中學習?)sequential decision making(如何讓模型學會探索並學出好的參數?)Lifelong learning(如何讓模型利用先前學習的知識,應用在後續的新場景?)等等。

展望未來,人類或許會和 AI 互相學習,人類提供 AI 資料,AI 提供人類新的觀點,從而變成 Human-inclusive AI 的社會。

結語

Masashi 的分享從一個應用機器學習於實際資料時很常見的問題出發,接著完整地介紹了許多狀況的對應方法,最後提及了對未來機器學習研究的觀點,他的分享從不同面向為機器學習的應用者帶來啟發。

最後,這次 Dev Day 還有許多跟 Machine Learning 有關的演講,除了分享的演講外,也有機器學習工程上的問題,以及在 LINE 業務上的應用等等,主題相當多元,熱愛機器學習的你絕對不能錯過!完整的議程及影片可至此觀看:https://linedevday.linecorp.com/2020/en/sessions?mode=all。

關於 TECH FRESH 計畫

2021 年的 TECH FRESH 實習生計畫預計從 3 月開始實習,我們正在尋找對技術有熱情、積極解決問題、勇於接受挑戰的優秀同學,目前招募通道已經開啟了,馬上手刀申請送出履歷,下一位 TECH FRESH 就是你!

若想更了解關於這個計畫的內容,歡迎讀者們參閱以下兩篇文章,更多的 FAQ 都已經整理在其中: